Na semana passada, pesquisadores do site Apple apresentaram o OpenELM, uma série de " modelos de linguagem eficientesde código aberto", na biblioteca de modelos Hugging Face. As quatro variantes variam em tamanho de 270 milhões de parâmetros a 3 bilhões e são as candidatas mais prováveis para IA no dispositivo para dispositivos Apple.

Para fins de contexto, o site Apple lançou discretamente uma estrutura de aprendizado de máquina chamada MLX em dezembro de 2023. O próximo foi o MLLM-Guided Image Editing (MGIE)seguido por uma sucessão de esforços de IA generativa, incluindo Keyframer, Ferret-UI e IA de preenchimento de código no Xcode. Em sua maioria, esses projetos aproveitam o poder de processamento do silício Apple em vez de transferir a funcionalidade de IA para a nuvem.

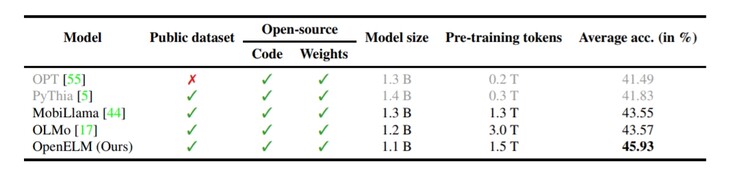

Na mesma linha, o OpenELM representa a abordagem no dispositivo da Apple em relação à IA. Normalmente, os LLMs públicos utilizam centenas de bilhões (às vezes trilhões) de variáveis para compreender a entrada do usuário e decidir sobre uma resposta adequada. Por outro lado, modelos de linguagem menores, como o Phi-3 da Microsoft, usam apenas 3,8 bilhões de parâmetros, enquanto o Google Gemma se orgulha de ter 2 bilhões. No entanto, devido à abordagem exclusiva do OpenELM para a arquitetura do modelo de transformador, o modelo chega a apenas 270 milhões de parâmetros.

Obviamente, há algumas desvantagens em ser pequeno. Por um lado, o OpenELM não é multimodal, pois tem poucos parâmetros para que isso seja viável. Além disso, seu conhecimento factual é bastante baixo, conforme demonstrado no relatório técnico https://www.google.com/url?sa=t&source=web&rct=j&opi=89978449&url=https://arxiv.org/abs/2404.14619&ved=2ahUKEwjthIWbmeyFAxXMXEEAHeVICrgQFnoECBQQAQ&usg=AOvVaw0lkrTbxKNgbdUB4po5zOEa . Esse problema afeta todos os LLMs públicos de tamanho semelhante. No entanto, o tamanho pequeno permite que o modelo de IA seja hospedado localmente em telefones ou laptops em vez de na nuvem.

Os Top 10

» Os Top 10 Portáteis Multimídia

» Os Top 10 Portáteis de Jogos

» Os Top 10 Portáteis Leves para Jogos

» Os Top 10 Portáteis Acessíveis de Escritório/Empresariais

» Os Top 10 Portáteis Premium de Escritório/Empresariais

» Os Top 10 dos Portáteis Workstation

» Os Top 10 Subportáteis

» Os Top 10 Ultrabooks

» Os Top 10 Conversíveis

» Os Top 10 Tablets

» Os Top 10 Smartphones

» A melhores Telas de Portáteis Analisadas Pela Notebookcheck

» Top 10 dos portáteis abaixo dos 500 Euros da Notebookcheck

» Top 10 dos Portáteis abaixo dos 300 Euros

Appleo lançamento público do OpenELM pela OpenLink externo é um desvio das práticas típicas da empresa. Desde a estrutura completa e a avaliação do modelo, até os registros de treinamento, as configurações de pré-treinamento e o código de inferência do MLX, todos os aspectos do modelo de linguagem estão publicamente disponíveis por meio da Hugging Face para que os desenvolvedores possam ajustá-lo e adaptá-lo a diferentes casos de uso. Ostensivamente, um lançamento tão extenso deve fortalecer a participação da Apple na IA, inspirando os pesquisadores a brincar com as possibilidades dos dispositivos Apple.

Mas há outros participantes nesse espaço. O Phi-3 da Microsoft é um rival muito competente, assim como os outros projetos abertos de LLM de Redmond. O Gemma 2B - 3B do Google é outro. Embora todos os modelos mencionados acima ainda sejam executados muito lentamente, o hardware e o software certamente estão se movendo na direção certa para modelos de linguagem pequenos.

Por enquanto, dispositivos de ponta, como o Samsung Galaxy S24 (a partir de US$ 799 na Amazon), ou o OnePlus 12R usando o Andes-GPT têm que contar com o processamento em nuvem. Independentemente de a Apple incorporar ou não o OpenELM no próximo iPhone, é provável que a empresa sediada em Cupertino colabore com o Google ou com o Open AI para funções de IA generativas mais pesadas.